Jedna otázka místo deseti benchmarků: mini IQ test pro nejnovější AI modely

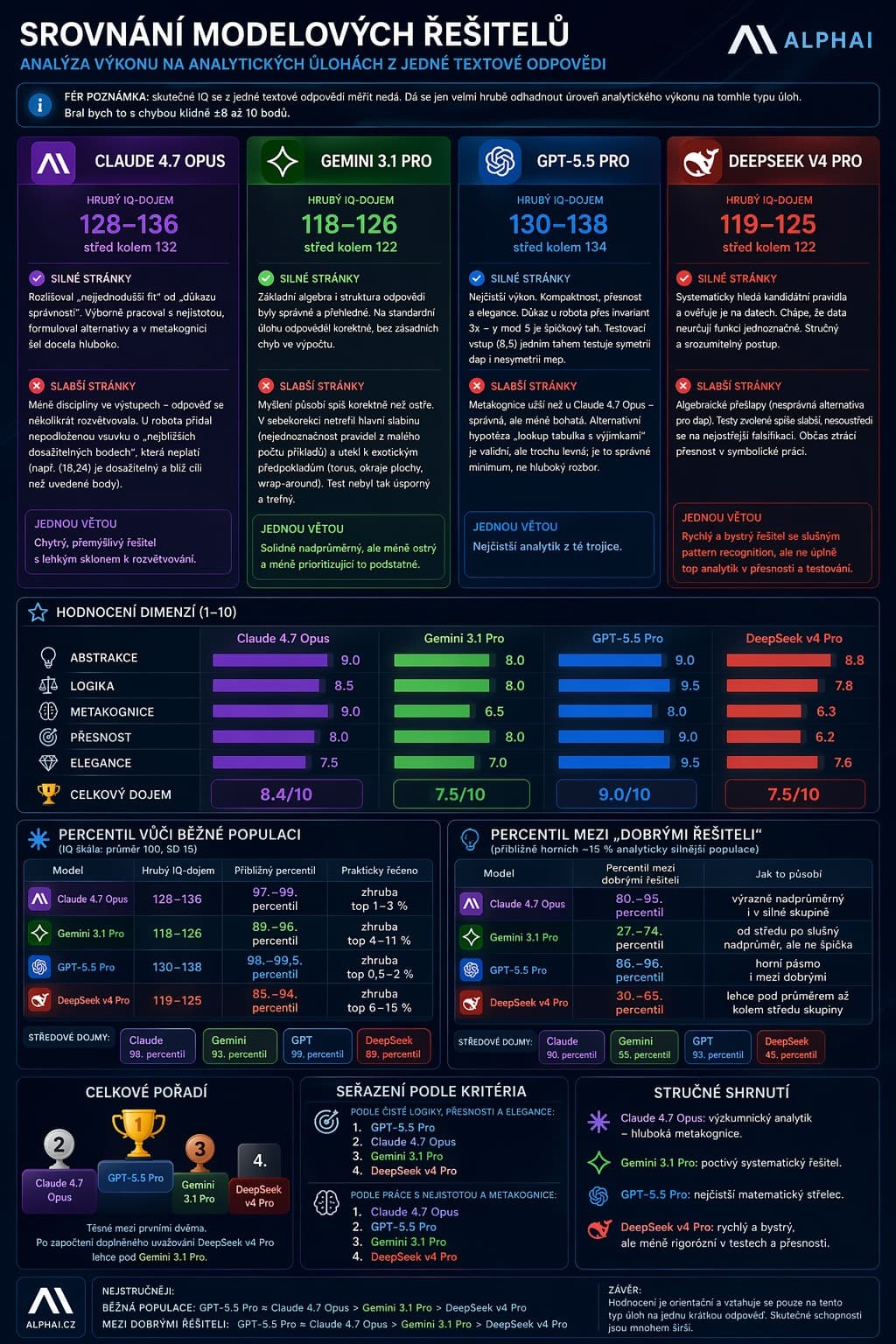

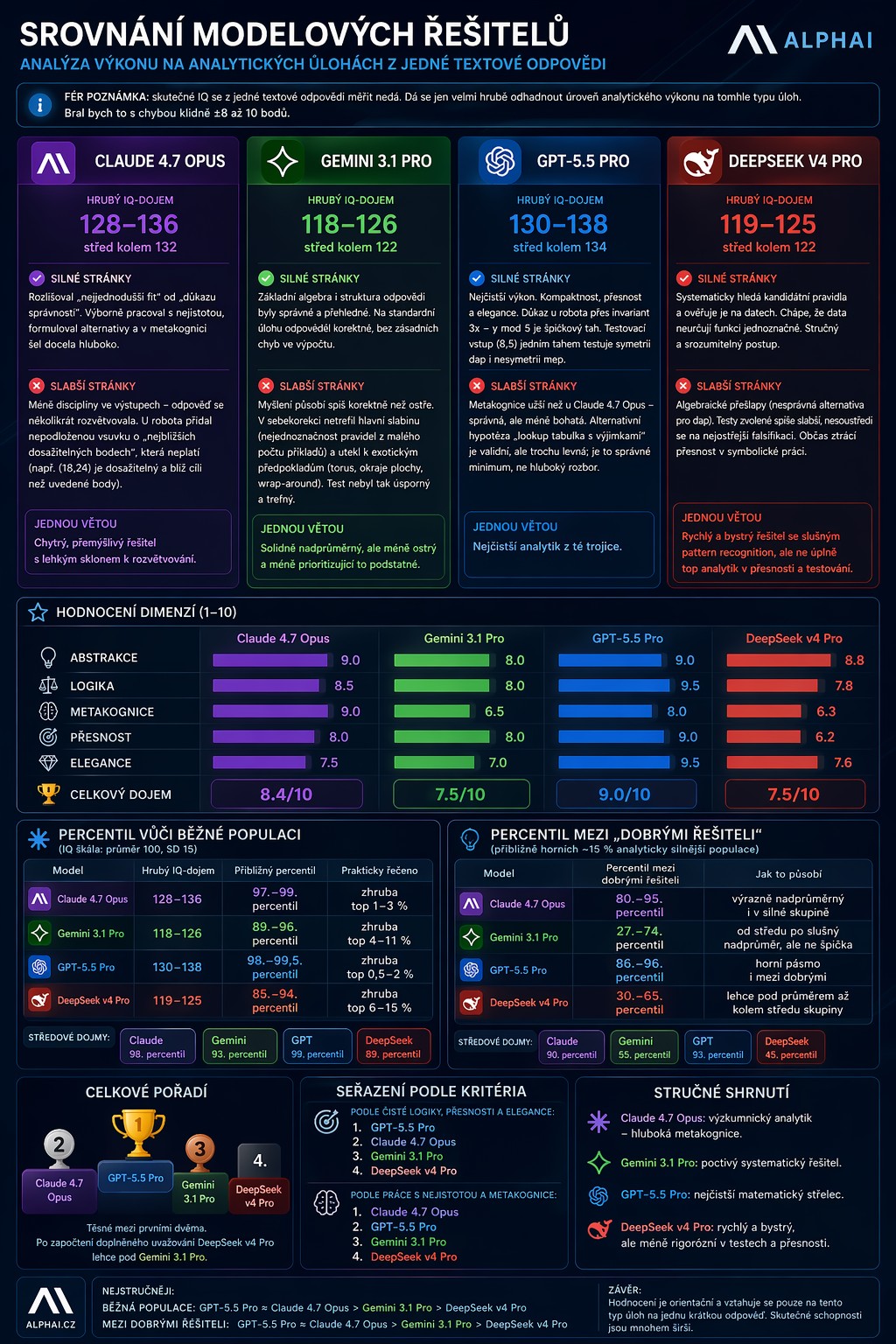

Vzal jsem nejnovější top modely AI a místo nekonečných benchmarků jim dal jedinou „geniální“ otázku: odhalit skryté pravidlo, spočítat nový případ, přiznat nejednoznačnost, navrhnout falsifikační test a zkritizovat vlastní řešení. Výsledek? Špička dnes vychází zhruba v pásmu 120–135+ IQ-dojmu — ale rozdíl už nedělá co modely vědí, ale jak čistě dokážou myslet pod tlakem.

Vzal jsem nejnovější top modely AI a místo nekonečných benchmarků jim dal jedinou „geniální" otázku: odhalit skryté pravidlo, spočítat nový případ, přiznat nejednoznačnost, navrhnout nejlepší falsifikační test a nakonec zkritizovat vlastní řešení.

A právě to je na tom zajímavé: nešlo o paměť ani o encyklopedii faktů, ale o syrové myšlení pod tlakem. O to víc, že šlo o modely prakticky „z pece":

- DeepSeek V4 vyšel dneska, 24. 4. 2026

- OpenAI oznámilo GPT-5.5 23. 4. 2026

- Anthropic uvedl Claude Opus 4.7 16. dubna 2026, tedy jen několik dní předtím

Výsledek? Jedna otázka odhalila víc než deset hezkých demo ukázek. Nejlepší modely nevyhrávají tím, že „věděly odpověď", ale tím, že uměly najít elegantní důkaz, přesně pojmenovat nejistotu a samy navrhnout test, který by je mohl shodit ze stolu.

Když jsme jejich výkon převedli do našeho hrubého IQ-dojmu, špička vycházela celkem vysoko: zhruba v pásmu 120 až 135+, samozřejmě ne jako klinické IQ, ale jako orientační měřítko analytické ostrosti.

Jinými slovy: rozdíly mezi top modely už dnes nedělá jen „kolik toho znají", ale jak čistě, tvrdě a poctivě umějí myslet.

Detailní rozpis hodnocení napříč modely, dimenzemi a percentily — viz infografika výše. Náhled na výpisu blogu je z technických důvodů ořezaný; kompletní obrázek se zobrazuje až tady v článku.

Zkuste to taky — mini IQ test pro lidi i AI

Pokud si chcete tenhle test zkusit, vyřešte následující úkol:

mep(2,5)=12

mep(3,4)=15

mep(4,7)=32

mep(1,9)=10

mep(0,6)=0

mep(5,0)=5

dap(2,5)=29

dap(3,4)=25

dap(4,7)=65

dap(1,9)=82

dap(0,6)=36

dap(5,0)=25

Odvoďte pravidla mep a dap.

- Pokud existuje víc možných pravidel, řekněte to explicitně.

- Spočítejte:

mep(5,8)=?adap(5,8)=? - Navrhněte jeden další vstup, který by vaši hypotézu nejlépe mohl vyvrátit.

- A nakonec napište, čím jste si ve své odpovědi nejméně jistí.

Co na to lidi v komentářích?

Příspěvek vyvolal na FB poměrně různorodou diskusi a stojí za to ji shrnout — protože i ona byla součástí experimentu.

Nejvíc reakcí mířilo na samotnou metodologii: že benchmarky přece neměří jednu věc, ale celé spektrum schopností. To je samozřejmě pravda — v praxi pracuju se skupinou cca 150 použitelných modelů a desítkami oficiálních i neoficiálních benchmarků, kde sleduju kreativní psaní, vytěžování informací z obrázků, sestavování prezentací, rychlost, cenu, míru halucinací i uhlíkovou stopu. Tahle „jedna otázka" tedy benchmarky nenahrazuje — je to rychlý sanity check, takový lakmusový papírek čistoty uvažování.

Jiní v komentářích sdíleli své vlastní zkušenosti s přechodem mezi modely: někdo přešel z ChatGPT na Gemini kvůli lepším radám okolo PC, jiný označil ChatGPT za halucinujícího veterána a Claude za „jinou ligu". A to je přesně ten obraz, který vidím i v datech: žádný model dnes nevyhrává všechno — vyhrává tam, kde se trefí jeho silná stránka do vašeho use-case.

Pak přišly i komentáře typu „triviální úloha" nebo „úplný blábol". Ano, samotný rébus je matematicky banální — mep(a,b) = a·(b+1) a dap(a,b) = a²+b². Ale smyslem testu nebylo to vyřešit — smyslem bylo sledovat, jestli model:

- uvidí, že 6 bodů funkci jednoznačně neurčuje,

- sám si navrhne falsifikační vstup, který hypotézu rozliší od konkurenčních,

- a poctivě přizná, čeho si není jistý.

A tam se ukazují skutečné rozdíly. Některé modely se utopí v sebedůvěře, jiné — třeba Claude Opus 4.7 — explicitně rozliší symetrické vs. asymetrické pravidlo, navrhnou test typu mep(5,2) (kde 12 vs. 15 rozhoduje o komutativitě) a otevřeně řeknou, že bez tohoto testu jsou jejich výpočty mep(5,8)=45 a dap(5,8)=89 podmíněné platností nejjednodušší hypotézy.

To je přesně ten typ uvažování, který v běžných benchmarcích jednoduše neuvidíte. A přesně proto má smysl občas nechat „velké modely" projít malou, drsnou otázkou.

Zkusíte úlohu vyřešit — vy nebo váš oblíbený model? Napište mi, jak dopadla.